来源丨快鲤鱼(id:akuailiyu)

作者丨李霜霜

编辑丨海腰

2023年6月13日,英伟达市值突破万亿美元大关,仅次于苹果、微软、alphabet和亚马逊,成为美国第五大市值公司,第二季度,英伟达在数据中心业务收入超过100亿美元,高于英特尔和amd营收之和。

gpu芯片在超级计算和全球巨头大模型训练战中地位举足轻重,而掌握全球80%gpu市场份额的英伟达赚得盆满钵满。然而,这种垄断式的市场占有率不是一夜砌成的“城墙”。

据tractica数据,预计到2025年全球ai硬件市场收入将达到2349亿美元,其中gpu的收入占23.2%。

英伟达在gpu市场的构筑的护城河,cuda是其中至关重要的一环。

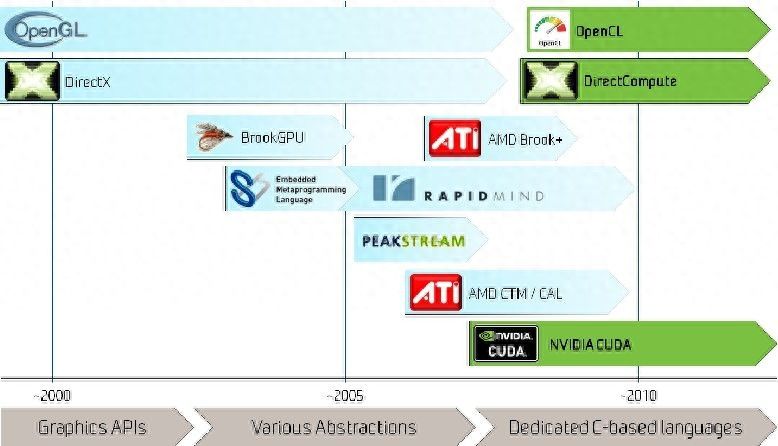

2006年,正是在amd收购了ati、英特尔依然蝉联全球第一大芯片厂商的时候,英伟达推出了cuda(compute unified device architecture),它是英伟达研发的平行运算平台及编程模型。

ai大神吴恩达简单评价了cuda的意义:“在cuda出现之前,全球能用gpu编程的可能不超过100人,有cuda之后使用gpu就变成一件非常轻松的事。”

多数cuda的推荐者认为,cuda完善的编译器生态是英伟达gpu在高性能计算领域成功的关键。

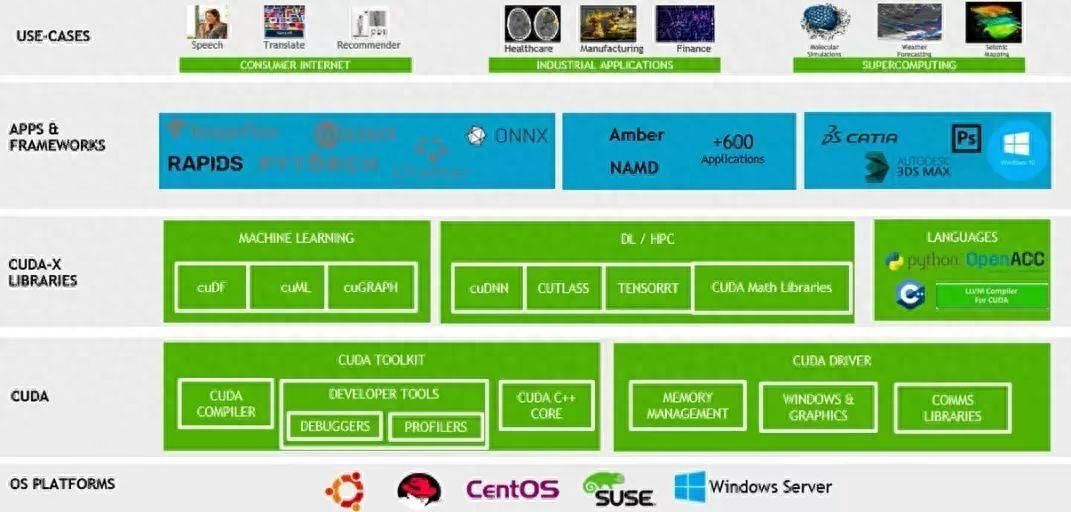

具体来讲,cuda具有易部署、开发接口灵活、编程语言适配、工具及代码库完备等优点,并且兼容windows、linux和macos多个操作系统。

cuda的开发让gpu不再是简单的图形处理器,适用对象也从游戏制作人变为科学家、工程师或艺术家。

随着不断迭代,cuda在针对ai或神经网络深度学习领域推出了非常多的加速库,构成了cuda的软硬件生态站。

大卫·罗森塔尔在acquired.fm中介绍,cuda的代码库是经过优化的,开发人员调用这些库开发程序更加便利。因此,cuda有庞大的社区资源,2023年5月注册开发者增加至400万人。

英伟达凭借cuda几乎垄断了训练芯片市场,业界也几乎没有巨头对cuda生态造成颠覆性冲击。

英伟达为cuda生态铺垫了十余年。

2007年,英伟达的gpu研发技术已占据强势地位,次年英特尔的大客户苹果将macbook除cpu外直接替换成英伟达tesla架构的gpu便印证了这一点。

据报道,经年累计英伟达对cuda总投入早已超过100亿美元。

在黄仁勋商业化考虑之下,cuda生态需要培养潜在开发者,成为受到程序员和企业欢迎的技术平台。

在2006年推出cuda后,英伟达的第一个战略便瞄准了“软件开发人员”,投入巨资让开发者习惯使用cuda平台。

初期,开发者社区有这样一句话:cuda在编程语言和共享存储器两个层次的并行都简化了编程,使得本科生也能使用cuda写出大规模高性能计算程序。

为扩大覆盖率,英伟达将cuda引入大学课堂,与伊利诺伊大学等高校合作完善函数库。在2010年时,已有250所大学开放cuda的教学课程,并有相关论文数千篇。以此为基础完善生态,英伟达建立研究中心、教学中心、认证计划,到2015年已有800所大学开发相关课程。

再从业界来看,英伟达投入资金做inception计划(初创加速计划),让初创公司运用cuda做项目铺垫基础。

至今,已有超过100家初创公司利用了cuda。此外,英伟达开源了cub、nccl等通用场景下的开发库,并优化中间件性能的基础库给厂家使用,再次扩大了生态系统。

因此,许多开发者依赖于cuda,同时凭借强大的核心能力在消费市场上受到青睐。

2012年,在imagenet竞赛一举夺冠的alexnet面世后,cuda已迭代至5.0版本,支持了动态库和gpu指针。

2016年,openai成立之时,cuda8.0已经支持半精度浮点数和张量核心,软件生态已由学界和业界人士熟知、互相推荐。

2022年底,chatgpt的发布将生成式ai送到人们眼前,cuda12.0支持了新的nvidia hopper 和 nvidia ada lovelace 架构功能,并为所有gpu提供了额外的编程模型增强。

等到大模型热度吹进各家企业时,英伟达已经深化了他们在行业中的差异化,成为市场玩家购物篮的第一选择。

目前为止,基于cuda的gpu销量超过百万。

而众多gpu芯片厂家中,为什么是英伟达做出了唯一的cuda开发环境?

回顾世纪初期,英伟达与微软、ati、amd、英特尔五家巨头的混战,英伟达在图形处理市场中逐渐占据优势。

2006年7月,amd以54亿美元溢价收购ati,芯片市场重新洗牌。同年,英伟达的首席科学家david kirk提出了“将gpu技术通用化”的思路,从主要做3d渲染的任务中脱离出来,探索通用计算任务。

这个思路就是cuda。而当时,愿意担起这门费钱费力的技术活的也是英伟达。

几大家芯片公司中,老对手amd买下ati后gpu研发进入弱势地位,英特尔取消了自研gpu计划。英伟达则在gpu技术方面将巨头们甩在了身后。

17年前,研发cuda是一个超前的决定,英伟达的cuda进化并非一帆风顺,黄仁勋则坚持“加速计算”是未来。

英伟达和英特尔在2006年秋天共同开发了基于cuda的新型gpu,即g80 gpu。而两者的合作持续不长久,cuda的研发决策需要英伟达长久地投入大量资金。

从产品特性上来说,cuda逻辑电路在硬件产品中增加会导致芯片的散热需求增高,由此也会带来成本上升、故障增多的风险。

从财报表现来看,cuda也是一门亏钱生意,在2008年金融危机前后表现得更为明显。

在最艰难的时候,黄仁勋也没有中断cuda,直到2012年辛顿教授带队以gpu代替cpu训练ai模型做出了alexnet。

2020年,黄仁勋在接受barron周刊时强调:“英伟达将推动下一个人工智能大爆炸。”

这5年,为了迎接人工智能,英伟达做了3件事。

第一,2019年3月,英伟达以69亿美元收购了高性能计算互联技术公司mellanox 。这家公司的主要产品infiniband,被认为速度更快、带宽更高,是数据传输的有效方式,而mellanox是唯一的infiniband规范提供商。

第二,英伟达于2022年9月发布新一代ai芯片“drive thor”,专为大规模gpu集群协调设计,是英伟达一款完全集成的j9九游会的解决方案。

第三,英伟达推出专为加速计算和生成式ai打造的hopper架构,h100便是基于此架构的gpu。市场消息称,h100是英伟达利润率高达1000%的产品,出货量超过900吨。

随着chatgpt发布,带动ai服务器出货量和价格上涨,英伟达的gpu芯片价格水涨船高。英伟达的dgx h100售价总价为268495美元,包含8gpu 4nvswitch基板等,每台毛利率接近190000美元。

英伟达的财务收入令人瞩目,据悉,过去3个财年的复合年增长率(cagr)达到35.2%,预计2023年收入将飙升51.4%至408亿美元。

2016年,amd推出基于开源项目的gpu生态系统rocm,类似英伟达的cuda系统,然而rocm技术相较落后,在2023年4月才登录windows平台。由于切入时间较晚,amd开发者数量远也低于英伟达。在github上,贡献cuda软件包仓库的开发者超过32600位,而rocm只有不到600个。

英伟达大约占据全球80%的gpu市场份额,光从销量来看,都是一家独大。

而英伟达的垄断市场的优势可以持续多久?

针对这一问题,semi analysis首席分析师dylan patel给出观点:随着pytorch支持更多gpu厂商,再加上openai的triton搅局,英伟达手中的利器cuda 逐渐锋芒不再。

软件生态来看,cuda的霸主地位确实受到各方攻击。

近年,ai开发框架pytorch因灵活的eager模式使用比率逐渐超越了tensorflow,pytorch2.0版本将会对amd、英特尔、特斯拉、谷歌等gpu和加速器进行支持完善。

openai则直接推出了“简化版cuda:triton”,操作难度低于cuda。

2023年第一季度,amd宣布rocm系统融入pytorch2.0框架,tensorflow和caffe深度学习框架也已加入第五代rocm。其6月发布下一代数据中心加速处理器(apu)amd mi300软件方面能够全面兼容英伟达cuda生态,被业内认为有机会挑战英伟达在人工智能的行业地位。

尽管如此,从算力角度来看,英伟达h100的升级产品dgx gh200解决了大规模ai的关键瓶颈,适配资金充沛且性能要求高的潜在客户。短期内,cuda生态仍然稳健,大多数需要训练芯片的用户在仍然会选择英伟达。